04. Introdução aos conhecimentos básicos de transmissão ao vivo

1. Colete vídeo e áudio

* 1.1 Capture vídeo e estrutura de codificação de áudio *

AVFoundation: AVFoundation é uma estrutura para reproduzir e criar dados de mídia audiovisual em tempo real. Ele também fornece uma interface Objective-C para manipular esses dados audiovisuais, como edição, rotação e recodificação

* 1.2 Equipamento de hardware de vídeo e áudio *

CCD: Sensor de imagem: Usado no processo de aquisição e processamento de imagens para converter imagens em sinais elétricos.

Captador: Sensor de som: utilizado no processo de coleta e processamento de som, convertendo som em sinais elétricos.

Dados de amostra de áudio: geralmente em formato PCM

Dados de amostragem de vídeo: geralmente, está no formato YUV ou RGB. O volume do áudio e vídeo original coletado é muito grande e precisa ser processado por tecnologia de compressão para melhorar a eficiência da transmissão

2. Processamento de vídeo (beleza, marca d'água)

Princípio de processamento de vídeo: como o vídeo é finalmente renderizado na tela por meio da GPU, quadro a quadro, podemos usar OpenGL ES para processar os quadros de vídeo, de modo que o vídeo tenha vários efeitos, como uma torneira fluindo A água passa por vários canos e, em seguida, flui para diferentes alvos

Agora, todos os tipos de aplicativos de beleza e efeitos especiais de adição de vídeo são implementados usando a estrutura GPUImage.

* Estrutura de processamento de vídeo *

GPUImage: GPUImage é uma poderosa estrutura de processamento de imagem / vídeo baseada em OpenGL ES. Ele encapsula vários filtros e também pode escrever filtros personalizados. Possui mais de 120 efeitos de filtro comuns integrados.

OpenGL: OpenGL (Open Graphics Library integral) é uma especificação que define uma linguagem de programação cruzada, interface de programação de plataforma cruzada, que é usada para imagens tridimensionais (bidimensional também é possível). OpenGL é uma interface de programa gráfico profissional, uma biblioteca gráfica subjacente poderosa e fácil de chamar.

OpenGL ES: OpenGL ES (OpenGL para sistemas incorporados) é um subconjunto da API de gráficos 3D OpenGL, projetado para dispositivos incorporados, como telefones celulares, PDAs e consoles de jogos.

3. Codificação e decodificação de vídeo

* 3.1 Estrutura de codificação de vídeo *

FFmpeg: é uma estrutura de vídeo de código aberto de plataforma cruzada que pode implementar funções ricas, como codificação, decodificação, transcodificação, streaming e reprodução de vídeo. Os formatos de vídeo e protocolos de reprodução suportados são muito ricos, incluindo quase todos os codecs de áudio e vídeo, formatos de encapsulamento e protocolos de reprodução.

-Libswresample: Pode realizar operações como reamostragem, rematrixagem e conversão do formato de amostragem do áudio.

-LibavCodec: Fornece uma estrutura geral de codecs, incluindo muitos vídeos, áudio, streams de legendas e outros codecs / decodificadores.

-Libavformat: usado para encapsular / desencapsular o vídeo.

-Libavutil: contém algumas funções comuns, como geração de números aleatórios, estrutura de dados, operações matemáticas, etc.

-Libpostproc: usado para algum pós-processamento do vídeo.

-Libswscale: usado para dimensionamento de imagem de vídeo, conversão de espaço de cor, etc.

-Libavfilter: Fornece função de filtro.

X264: codificação YuV e compactação dos dados do vídeo original no formato H.264

VideoToolbox: API de codificação e decodificação de vídeo da própria Apple, mas aberta apenas após iOS8.

audioToolbox: a própria API de decodificação e codificação de áudio da Apple

* 3.2 Tecnologia de codificação de vídeo *

Padrões de codificação de compressão de vídeo: tecnologias de codificação para compressão de vídeo (codificação de vídeo) ou descompactação (decodificação de vídeo), como MPEG, H.264, essas tecnologias de codificação de vídeo são codificação de compressão de vídeo

Função principal: comprimir os dados de pixel de vídeo em um fluxo de vídeo, reduzindo assim a quantidade de dados de vídeo. Se o vídeo não estiver compactado e codificado, o volume geralmente é muito grande e um filme pode exigir centenas de gigabytes de espaço.

Nota: O que mais influencia a qualidade do vídeo são seus dados de codificação de vídeo e dados de codificação de áudio, que não tem nada a ver com o formato da embalagem

MPEG: Um método de compressão de vídeo que usa compressão entre quadros, armazenando apenas as diferenças entre quadros consecutivos, de modo a atingir uma taxa de compressão maior

H.264 / AVC: Um método de compressão de vídeo que usa pré-predição e o mesmo método de predição de quadro que o quadro PB em MPEG. Ele pode gerar um fluxo de vídeo adequado para transmissão em rede de acordo com as necessidades e tem uma taxa de compressão mais alta. Tem melhor qualidade de imagem

Nota 1: Se você comparar a definição de uma única tela, o MPEG4 tem uma vantagem; da definição de continuidade de ação, H.264 tem uma vantagem

Nota 2: Como o algoritmo de 264 é mais complexo, o programa é complicado de implementar e precisa de mais recursos de processador e memória para executá-lo. Portanto, a execução do 264 requer requisitos de sistema relativamente altos.

Nota 3: Como a implementação de 264 é mais flexível, algumas implementações são deixadas para os próprios fabricantes. Embora isso traga muitos benefícios para a implementação, a intercomunicação entre diferentes produtos tornou-se um grande problema, resultando na adoção da empresa A. Os dados compilados pelo codificador devem ser resolvidos pelo decodificador da Empresa A para resolver tais coisas constrangedoras

H.265 / HEVC: Um método de compressão de vídeo baseado em H.264, mantendo algumas das tecnologias originais, enquanto melhora algumas tecnologias relacionadas para melhorar a relação entre fluxo de bits, qualidade de codificação, atraso e relações de complexidade de algoritmo para atingir a configuração ideal.

H.265 é um padrão de codificação mais eficiente, que pode comprimir o volume do conteúdo para um tamanho menor sob o mesmo efeito de qualidade de imagem e transmitir mais rápido e economizar largura de banda.

I frame: (key frame) mantém uma imagem completa, só precisa dos dados deste frame para completar a decodificação (pois contém a imagem completa

Quadro P: (Quadro de diferença) A diferença entre este quadro e o quadro anterior é mantida. Ao decodificar, a imagem previamente armazenada em buffer precisa ser sobreposta à diferença definida por esse quadro para gerar a imagem final. (O quadro P não possui dados de imagem completos, apenas dados que são diferentes da imagem do quadro anterior)

Quadro B: (quadro de diferença bidirecional) preserva a diferença entre o quadro atual e os quadros anterior e seguinte. Para decodificar o quadro B, não apenas a imagem armazenada no buffer anterior deve ser obtida, mas também a imagem decodificada. O resultado final é obtido através da sobreposição das imagens frontal e traseira e os dados do quadro atual Imagem. A taxa de compressão de quadros B é alta, mas a CPU ficará mais cansada durante a decodificação

Compressão intra-quadro: Ao comprimir um quadro de imagem, apenas os dados desse quadro são considerados, sem considerar as informações redundantes entre os quadros adjacentes. Geralmente, um algoritmo de compressão com perdas é usado no quadro

Compressão InteRFrame: compressão temporal, que comprime dados comparando dados entre diferentes quadros no eixo do tempo. A compressão entre quadros é geralmente sem perdas

muxing (síntese): Encapsula streams de vídeo, streams de áudio e até mesmo streams de legendas em um arquivo (formato de contêiner (FLV, TS)) e transmite-o como um sinal.

* 3.3 Tecnologia de codificação de áudio *

AAC, mp3: são tecnologias de codificação de áudio, usadas para áudio compactado

* 3.4 Controle de taxa *

Multi-bitrate: A situação de rede em que o público se encontra é muito complicada, pode ser WiFi, pode ser 4G, 3G ou até 2G, então como atender às necessidades de múltiplas partes? Construa mais algumas linhas e personalize a taxa de bits de acordo com o ambiente de rede atual.

Por exemplo: vejo frequentemente 1024, 720, HD, SD, suave, etc. em software de reprodução de vídeo, que se referem a várias taxas de bits.

* 3.5 Formato de embalagem de vídeo *

TS: um formato de encapsulamento de mídia de streaming. O encapsulamento de mídia de streaming tem a vantagem de não precisar carregar o índice antes da reprodução, o que reduz muito o atraso do primeiro carregamento. Se o filme for relativamente longo, o índice do arquivo mp4 é bastante grande, o que afeta a experiência do usuário

Por que usar TS: isso ocorre porque dois clipes de TS podem ser emendados perfeitamente e o player pode reproduzir continuamente

FLV: Um formato de encapsulamento de mídia de streaming. Devido ao tamanho do arquivo extremamente pequeno e velocidade de carregamento extremamente rápida, é possível assistir a arquivos de vídeo na Internet. Portanto, o formato FLV se tornou o principal formato de vídeo hoje.

4. Empurre o fluxo

* 4.1 Estrutura de transmissão de dados *

librtmp: usado para transmitir dados em formato de protocolo RTMP

* 4.2 Protocolo de transmissão de dados de mídia de streaming *

RTMP: protocolo de mensagens em tempo real, um protocolo aberto desenvolvido pela Adobe Systems para transmissão de áudio, vídeo e dados entre Flash players e servidores. Por ser um protocolo aberto, tudo pode ser usado.

O protocolo RTMP é usado para a transmissão de objetos, vídeo e áudio.

Este protocolo é construído sobre o protocolo TCP ou protocolo HTTP de pesquisa

O protocolo RTMP é como um contêiner usado para armazenar pacotes de dados. Esses dados podem ser dados audiovisuais em FLV. Uma única conexão pode transmitir vários fluxos de rede através de canais diferentes, e os pacotes nesses canais são transmitidos em pacotes de tamanho fixo

pedaço: pacote de mensagem

5. Servidor de streaming de mídia

* 5.1 Servidores comumente usados *

SRS: Um excelente sistema de servidor de streaming de mídia de código aberto desenvolvido por chineses

BMS: também é um sistema de servidor de streaming de mídia, mas não de código aberto. É uma versão comercial do SRS e tem mais funções do que o SRS

nginx: servidor da web gratuito e de código aberto, normalmente usado para configurar servidores de mídia de streaming.

* 5.2 Distribuição de dados *

CDN: (Content Delivery Network), a rede de distribuição de conteúdo, publica o conteúdo do site na "ponta" da rede mais próxima do usuário, para que o usuário possa obter o conteúdo desejado nas proximidades, resolve o congestionamento da rede da Internet , e melhora o acesso do usuário à velocidade de resposta do site.

CDN: servidor proxy, equivalente a um intermediário.

O princípio de funcionamento do CDN: como solicitar dados de mídia de streaming

1. Carregue dados de mídia de streaming para o servidor (site de origem)

2. A estação de origem armazena dados de mídia de streaming

3. O cliente reproduz a mídia de streaming e solicita os dados de mídia de streaming codificados do CDN

4. O servidor CDN responde à solicitação. Se os dados de mídia de streaming não existirem no nó, ele continuará a solicitar os dados de mídia de streaming da estação de origem; se o arquivo de vídeo já estiver armazenado em cache no nó, pule para a etapa 6.

5. O site de origem responde à solicitação de CDN e distribui a mídia de streaming para o nó CDN correspondente

6. O CDN envia dados de mídia de streaming para o cliente

De volta à origem: quando um usuário visita um determinado URL, se o nó CDN analisado não armazenar em cache o conteúdo da resposta ou se o cache tiver expirado, ele retornará ao site de origem para obter a pesquisa. Se ninguém visitar, o nó CDN não irá ativamente ao site de origem para obtê-lo.

Largura de banda: a quantidade total de dados que podem ser transmitidos em um tempo fixo,

Por exemplo, um barramento frontal de 64 MHz de 800 bits, sua taxa de transferência de dados é igual a 64 bits × 800 MHz ÷ 8 (Byte) = 6.4 GB / s

Balanceamento de carga: um conjunto de servidores é composto de vários servidores de maneira simétrica. Cada servidor tem um status equivalente e pode fornecer serviços de forma independente, sem a ajuda de outros servidores.

Por meio de uma determinada tecnologia de compartilhamento de carga, as solicitações enviadas de fora são distribuídas uniformemente para um determinado servidor na estrutura simétrica, e o servidor que recebe a solicitação responde de forma independente à solicitação do cliente.

O balanceamento de carga pode distribuir uniformemente as solicitações do cliente para a matriz do servidor, fornecendo assim acesso rápido a dados importantes e resolvendo o problema de um grande número de serviços de acesso simultâneos.

Essa tecnologia de cluster pode atingir um desempenho próximo ao de um mainframe com um investimento mínimo.

QoS (gerenciamento de largura de banda): Limita a largura de banda de cada grupo, de modo que a largura de banda limitada possa ser usada em seu efeito máximo

6. Puxe o fluxo

Seleção de protocolo de transmissão ao vivo:

RTMP, RTSP podem ser usados para aqueles com altos requisitos de tempo real ou necessidades interativas

Para aqueles com requisitos de reprodução ou plataforma cruzada, HLS é recomendado

Comparação do protocolo de transmissão ao vivo: (5)

HLS: Um protocolo para streaming em tempo real definido pela Apple. O HLS é implementado com base no protocolo HTTP. O conteúdo da transmissão inclui duas partes, uma é o arquivo de descrição M3U8 e a outra é o arquivo de mídia TS. Pode realizar streaming de mídia ao vivo e sob demanda, usado principalmente no sistema iOS

HLS é obter transmissão ao vivo por tecnologia sob demanda

HLS é um streaming de taxa de bits adaptável. O cliente selecionará automaticamente os fluxos de vídeo com taxas de bits diferentes de acordo com as condições da rede. Use taxas de bits altas se as condições permitirem e taxas de bits baixas quando a rede estiver ocupada e alterne automaticamente entre as duas à vontade

mudança. Isso é muito útil para garantir uma reprodução uniforme quando as condições de rede do dispositivo móvel são instáveis.

O método de implementação é que o servidor fornece um fluxo de vídeo com múltiplas taxas de bits, e isso é anotado no arquivo de lista, e o player se ajusta automaticamente de acordo com o progresso da reprodução e a velocidade de download.

Comparação de HLS e RTMP: HLS é principalmente devido ao atraso relativamente grande, e a principal vantagem de RTMP é a baixa latência

O método de pequena fatia do protocolo HLS irá gerar um grande número de arquivos e armazenar ou processar esses arquivos causará um grande desperdício de recursos

Em comparação com o protocolo SP, a vantagem é que, uma vez concluída a segmentação, o processo de distribuição subsequente não precisa usar nenhum software especial. Um servidor de rede comum é suficiente, o que reduz muito os requisitos de configuração do servidor de borda CDN, e qualquer CDN pronto pode ser usado. E os servidores em geral raramente oferecem suporte a RTSP.

HTTP-FLV: streaming de conteúdo de mídia com base no protocolo HTTP.

Comparado com o RTMP, o HTTP é mais simples e conhecido, o atraso do conteúdo também pode ser de 1 a 3 segundos e a velocidade de abertura é mais rápida, porque o próprio HTTP não tem interação de estado complexa. Portanto, da perspectiva da latência, HTTP-FLV é melhor do que RTMP.

RTSP: protocolo de streaming em tempo real, define como aplicativos um-para-muitos podem transmitir dados multimídia de forma eficaz por meio de uma rede IP.

RTP: Protocolo de transporte em tempo real. O RTP é baseado no protocolo UDP e é freqüentemente usado junto com o RTCP. Ele não fornece mecanismo de entrega no prazo ou outras garantias de qualidade de serviço (QoS). Ele conta com serviços de baixo nível para realizar esse processo.

RTCP: protocolo de suporte do RTP, a principal função é fornecer feedback sobre a qualidade do serviço (QoS) fornecido pela RTP, e coletar informações estatísticas sobre a conexão de mídia, como o número de bytes transmitidos, o número de pacotes transmitidos, o número de pacotes perdidos, redes unidirecionais e bidirecionais Atraso e assim por diante.

7. Decodificação

* 7.1 Decapsulação *

Demuxing (separação): Decomponha o vídeo, áudio ou legendas do arquivo (formato de contêiner (FLV, TS)) sintetizado do fluxo de vídeo, áudio e legenda e decodifique-os separadamente.

* 7.2 Estrutura de codificação de áudio *

fdk_aac: estrutura de codificação e decodificação de áudio, dados de áudio PCM e conversão de dados de áudio AAC

* 7.3 Introdução à decodificação *

Decodificação rígida: use a GPU para decodificar, reduzir as operações da CPU

Vantagens: reprodução suave, baixo consumo de energia, velocidade de decodificação rápida,

* Desvantagens: baixa compatibilidade

Decodificação suave: use a CPU para decodificar

Vantagens: boa compatibilidade

* Desvantagens: aumento da carga da CPU, aumento do consumo de energia, nenhum hardware

Decodificação suave, velocidade de decodificação relativamente lenta

8. Jogar

ijkplayer: um reprodutor de vídeo Android / iOS de código aberto baseado em FFmpeg

A API é fácil de integrar;

A configuração de compilação pode ser cortada para facilitar o controle do tamanho do pacote de instalação;

Suporte para decodificação de aceleração de hardware, mais economia de energia

Simples e fácil de usar, especifique a URL de streaming, decodifique e reproduza automaticamente.

9. Interação de bate-papo

IM: (InstantMessaging) Instant messaging: é um sistema de comunicação em tempo real que permite que duas ou mais pessoas usem a rede para comunicar em tempo real mensagens de texto, arquivos, voz e vídeo.

O principal papel do IM no sistema de transmissão ao vivo é realizar a interação do texto entre o público e o apresentador, e entre o público e o público.

* SDK de terceiros *

Nuvem Tencent: SDK de mensagens instantâneas fornecido pela Tencent, que pode ser usado como uma sala de chat ao vivo

Rongyun: um SDK de mensagens instantâneas comumente usado que pode ser usado como uma sala de chat ao vivo

5. Como desenvolver rapidamente um aplicativo completo de streaming ao vivo para iOS

1. Use SDK de streaming ao vivo de terceiros para desenvolvimento rápido

Qiniu Cloud: Qiniu Live Cloud é um serviço global de streaming ao vivo criado especificamente para plataformas de streaming ao vivo e uma plataforma de serviço de nuvem de streaming ao vivo de nível empresarial que implementa cenários de streaming ao vivo de ponta a ponta SDK.

* Plataformas de transmissão ao vivo como Panda TV e Dragon Ball TV usam Qiniu Cloud

NetEase Video Cloud: Com base na tecnologia de codec de vídeo de plataforma cruzada profissional e rede de distribuição de conteúdo de vídeo em grande escala, fornece serviços de áudio e vídeo em tempo real estáveis, suaves, de baixa latência e alta simultaneidade, e pode conectar vídeo ao vivo de forma integrada seu próprio aplicativo.

2. Por que empresas terceirizadas de SDKs nos fornecem SDKs?

Esperamos amarrar nosso produto e ele ao mesmo barco e confiar mais nele.

A tecnologia ganha dinheiro e ajuda a levantar um grande número de programadores

3. Função de transmissão ao vivo: autopesquisa ou uso de desenvolvimento de SDK de transmissão ao vivo de terceiros?

Desenvolvimento de SDK de terceiros: para uma equipe de start-up, a transmissão ao vivo autodesenvolvida tem um grande limite em termos de limite técnico, CDN e largura de banda, e leva muito tempo para fazer um produto acabado, o que não é propício ao investimento.

Autopesquisa: a plataforma de transmissão ao vivo da empresa é grande. No longo prazo, a autopesquisa pode economizar custos e os aspectos técnicos são muito mais controláveis do que o uso direto do SDK.

4. Benefícios do SDK de terceiros

abaixe o custo

Use bons serviços corporativos terceirizados, você não terá mais que gastar preços altos para contratar headhunters para cavar vacas grandes e caras, e não há necessidade de apaziguar o temperamento pessoal das vacas grandes.

Melhore a eficiência

O foco dos serviços de terceiros e a comodidade trazida pela integração do código podem levar apenas 1-2 horas, o que economiza quase 99% do tempo, o que é suficiente em troca de mais tempo para lutar contra os concorrentes e aumentar mais. Grande possibilidade de sucesso

reduzir o risco

Com a ajuda de serviços profissionais terceirizados, devido às suas características rápidas, profissionais, estáveis e outras, pode aumentar significativamente a competitividade dos produtos (serviços de alta qualidade, velocidade de pesquisa e desenvolvimento, etc.) e encurtar o período de teste e a hora do erro, que certamente será um dos meios para salvar vidas no empreendedorismo.

|

|

|

|

Como distante (long) a tampa do transmissor?

A faixa de transmissão depende de muitos fatores. A distância real baseia-se na altura da antena de instalar, o ganho da antena, usando ambiente como a construção e outras obstruções, a sensibilidade do receptor, a antena do receptor. Instalação de antena mais alta e usando no campo, a distância vai muito mais longe.

EXEMPLO 5W FM Transmitter usar na cidade e cidade natal:

Eu tenho um uso do cliente 5W transmissor FM EUA com antena GP em sua cidade natal, e ele testá-lo com um carro, cobrir 10km (6.21mile).

I testar o transmissor FM 5W com antena GP na minha cidade natal, que cobrem cerca de 2km (1.24mile).

I testar o transmissor FM 5W com antena GP na cidade de Guangzhou, que abrangem cerca de única 300meter (984ft).

Abaixo estão o intervalo aproximado de diferentes transmissores de energia FM. (O intervalo é de diâmetro)

0.1W ~ 5W Transmissor FM: 100M ~ 1KM

5W ~ 15W FM Ttransmitter: 1KM ~ 3KM

15W ~ 80W Transmissor FM: 3KM ~ 10KM

80W ~ 500W Transmissor FM: 10KM ~ 30KM

500W ~ 1000W Transmissor FM: 30KM ~ 50KM

1KW ~ 2KW Transmissor FM: 50KM ~ 100KM

2KW ~ 5KW Transmissor FM: 100KM ~ 150KM

5KW ~ 10KW Transmissor FM: 150KM ~ 200KM

Como contactar-nos para o transmissor?

Ligue-me + 8618078869184 OR

Me mande um e-mail [email protegido]

1.How longe você quer cobrir de diâmetro?

2.How altura de vocês torre?

3.Where você é?

E vamos dar-lhe conselhos mais profissional.

Sobre Nós

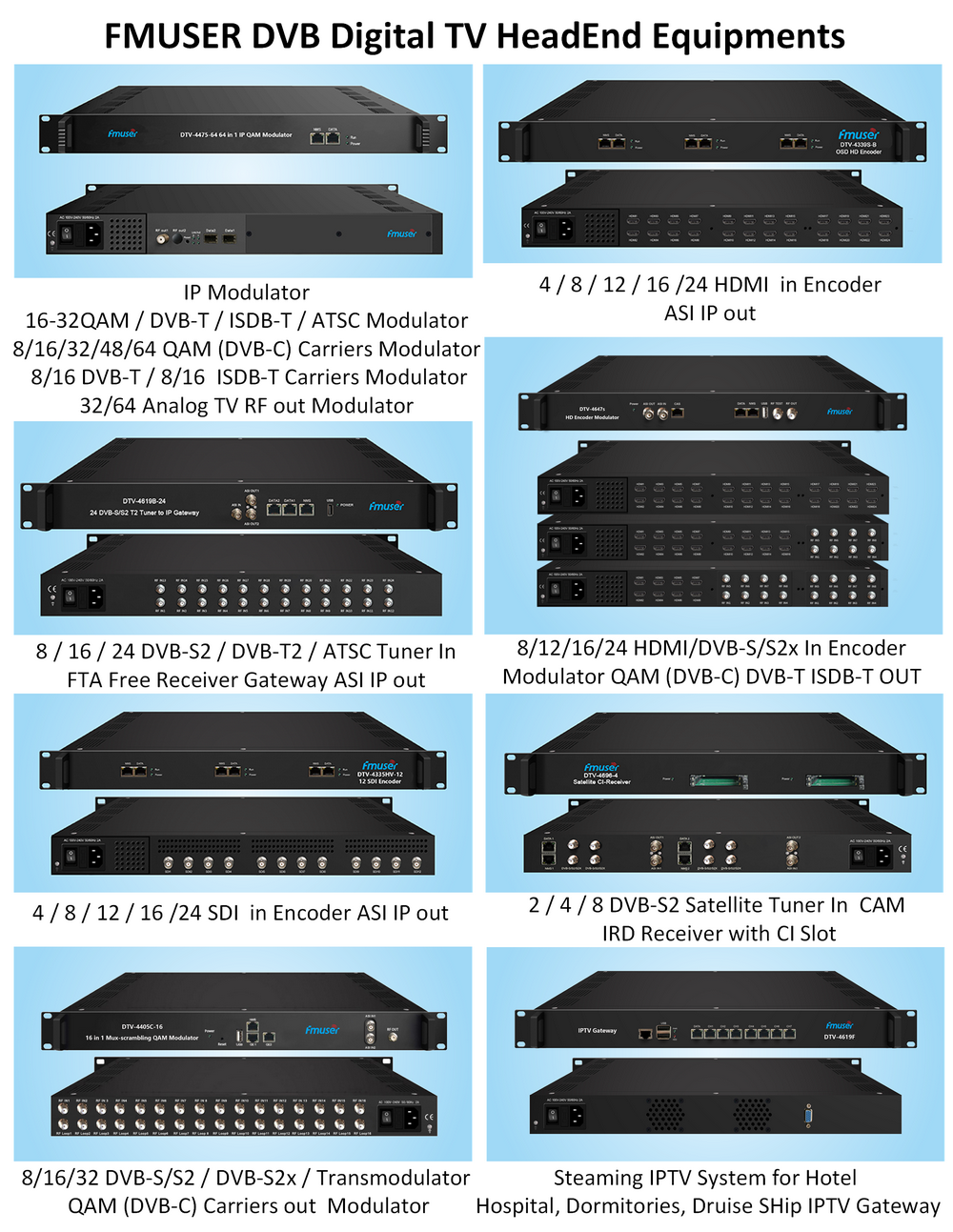

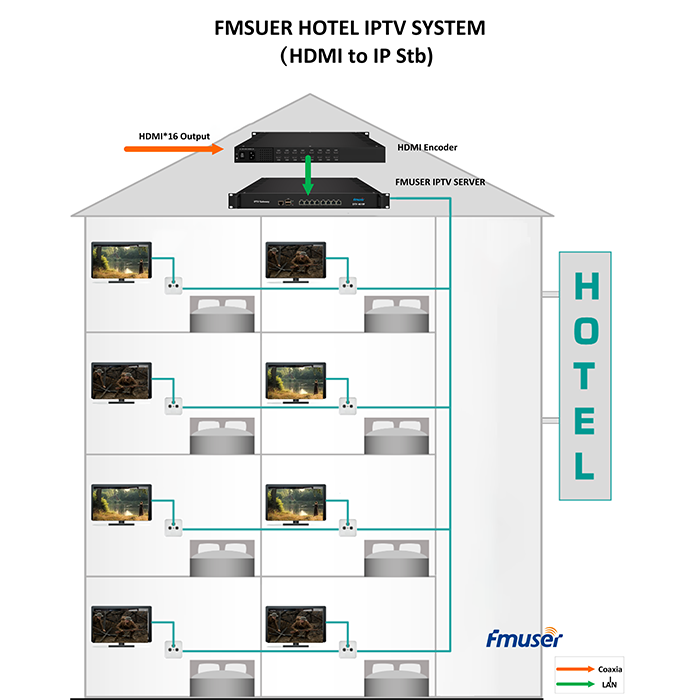

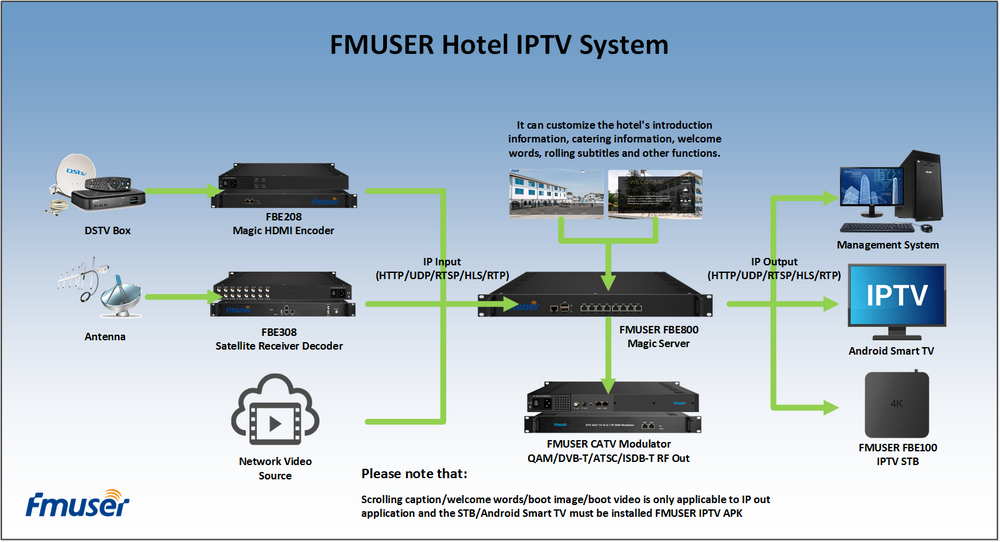

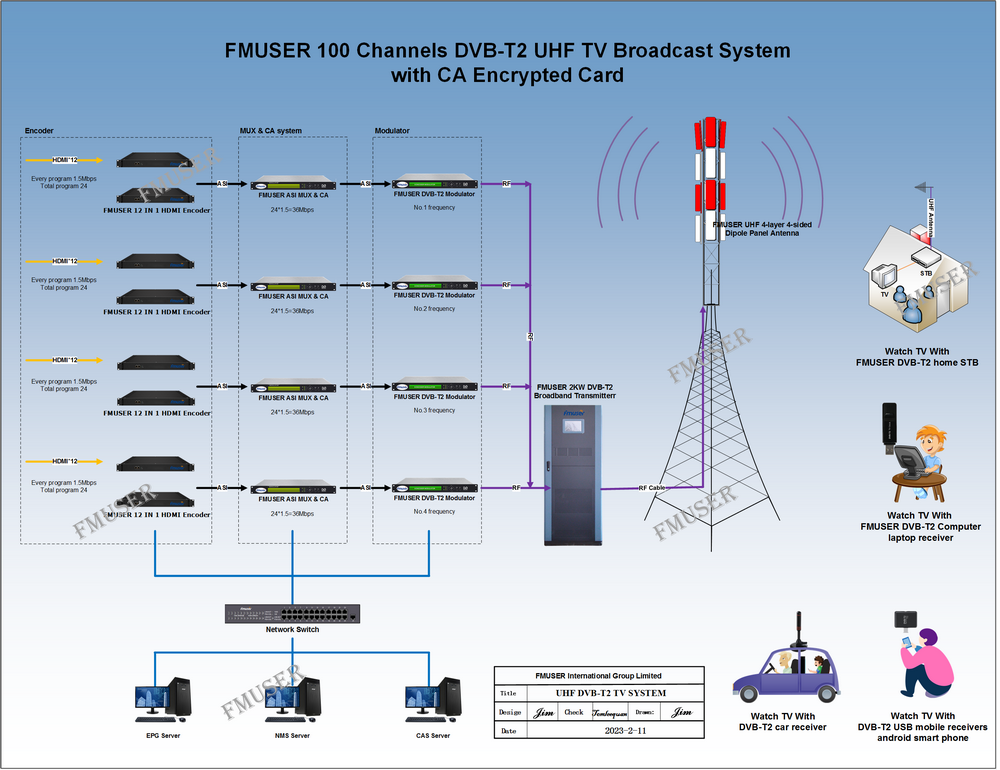

A FMUSER.ORG é uma empresa de integração de sistemas com foco em transmissão de RF sem fio / equipamento de áudio de vídeo de estúdio / streaming e processamento de dados. Fornecemos desde consultoria e consultoria até integração de rack a instalação, comissionamento e treinamento.

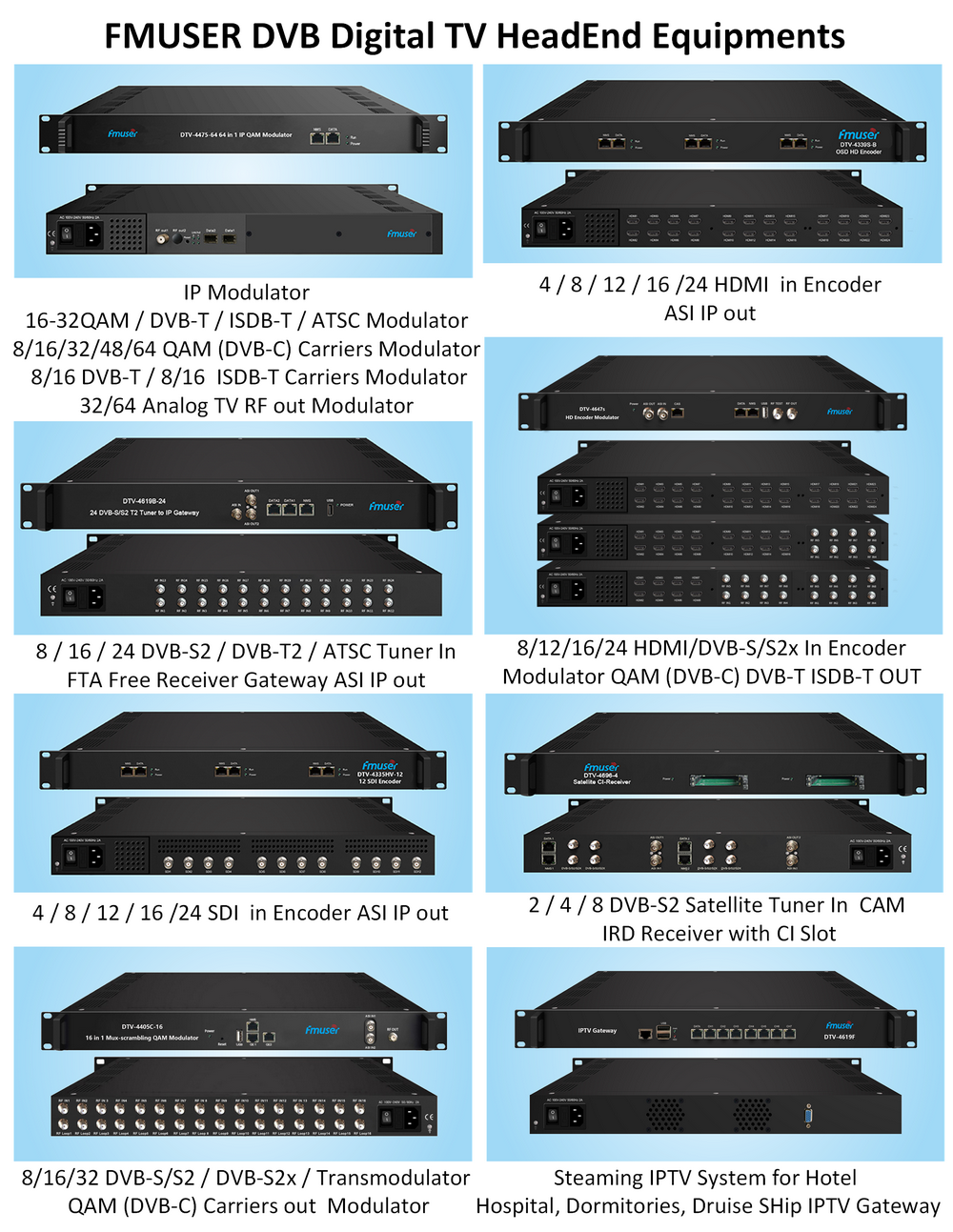

Oferecemos Transmissor FM, Transmissor de TV Analógico, Transmissor de TV Digital, Transmissor UHF VHF, Antenas, Conectores Coaxiais, STL, Processamento On Air, Produtos Broadcast para Estúdio, Monitoramento de Sinais RF, Codificadores RDS, Processadores de Áudio e Unidades de Controle Remoto, Produtos de IPTV, codificador / decodificador de vídeo / áudio, projetados para atender às necessidades tanto de grandes redes de transmissão internacionais quanto de pequenas estações privadas.

Nossa solução possui Estação de Rádio FM / Estação de TV Analógica / Estação de TV Digital / Equipamento de Estúdio de Áudio / Vídeo / Link de Transmissor de Estúdio / Sistema de Telemetria de Transmissor / Sistema de TV de Hotel / Transmissão ao Vivo de IPTV / Transmissão ao Vivo de Transmissão / Conferência de Vídeo / Sistema de Transmissão de CATV.

Estamos usando produtos de tecnologia avançada para todos os sistemas, porque sabemos que a alta confiabilidade e o alto desempenho são tão importantes para o sistema e a solução. Ao mesmo tempo, também temos que garantir que nosso sistema de produtos tenha um preço muito razoável.

Temos clientes de radiodifusores públicos e comerciais, operadoras de telecomunicações e autoridades reguladoras, além de oferecer soluções e produtos para centenas de pequenas emissoras locais e comunitárias.

A FMUSER.ORG exporta há mais de 15 anos e tem clientes em todo o mundo. Com 13 anos de experiência neste campo, temos uma equipe profissional para resolver todos os tipos de problemas dos clientes. Nós nos dedicamos a fornecer preços extremamente razoáveis para produtos e serviços profissionais. Email de contato : [email protegido]

Nossa fábrica

Nós temos modernização da fábrica. Você está convidado a visitar nossa fábrica quando você vir para a China.

Actualmente, já existem clientes 1095 em todo o mundo visitaram nosso escritório Guangzhou Tianhe. Se você vir para a China, você está convidado a visitar-nos.

na Feira

Esta é a nossa participação em 2012 Global Sources Hong Kong Fair Eletrônica . Clientes de todo o mundo finalmente ter a chance de ficar juntos.

Onde está Fmuser?

Você pode pesquisar esses números " 23.127460034623816,113.33224654197693 "no google map, então você pode encontrar nosso escritório fmuser.

escritório FMUSER Guangzhou está em Tianhe District, que é a centro do cantão . Muito perto ao Feira de Cantão , Estação Ferroviária Guangzhou, estrada Xiaobei e dashatou , só precisa 10 minutos se tomar TÁXI . Bem-vindos amigos de todo o mundo para visitar e negociar.

Contato: Céu azul

Celular: + 8618078869184

WhatsApp: + 8618078869184

WeChat: + 8618078869184

E-mail [email protegido]

QQ: 727926717

Skype: sky198710021

Endereço: No.305 quarto Huilan Edifício No.273 Huanpu Estrada Guangzhou China Zip: 510620

|

|

|

|

Inglês: Aceitamos todos os pagamentos, como PayPal, cartão de crédito, Western Union, Alipay, Money Bookers, T / T, LC, DP, DA, OA, Payoneer, se você tiver alguma dúvida, entre em contato comigo [email protegido] ou WhatsApp + 8618078869184

-

PayPal.  www.paypal.com www.paypal.com

Recomendamos que você use Paypal para comprar nossos produtos, o Paypal é uma forma segura de comprar na internet.

Cada da nossa lista de itens de página de fundo na parte superior tem um logotipo paypal para pagar.

Cartão de crédito.Se você não tem paypal, mas você tem cartão de crédito, você também pode clicar no botão amarelo PayPal para pagar com seu cartão de crédito.

-------------------------------------------------- -------------------

Mas se você não tiver um cartão de crédito e não tem uma conta paypal ou de difícil tem um accout PayPal, você pode usar o seguinte:

Western Union.  www.westernunion.com www.westernunion.com

Pagamento por Western Union para mim:

Nome próprio / nome próprio: Yingfeng

Sobrenome / sobrenome / sobrenome: Zhang

Nome completo: Yingfeng Zhang

País: China

Cidade: Guangzhou

|

-------------------------------------------------- -------------------

T / T. Pagar por T / T (transferência bancária / transferência telegráfica / Transferência Bancária)

Primeiras INFORMAÇÕES BANCÁRIAS (CONTA DA EMPRESA):

SWIFT BIC: BKCHHKHHXXX

Nome do banco: BANK OF CHINA (HONG KONG) LIMITADA, HONG KONG

Endereço do Banco: BANK OF CHINA TOWER, 1 GARDEN ROAD, CENTRAL, HONG KONG

CÓDIGO BANCÁRIO: 012

Nome da conta: FMUSER INTERNATIONAL GROUP LIMITED

Conta NO. : 012-676-2-007855-0

-------------------------------------------------- -------------------

SEGUNDA INFORMAÇÃO BANCÁRIA (CONTA DA EMPRESA):

Beneficiário: Fmuser International Group Inc

Número da conta: 44050158090900000337

Banco do beneficiário: Sucursal do China Construction Bank em Guangdong

Código SWIFT: PCBCCNBJGDX

Endereço: NO.553 Tianhe Road, Guangzhou, Guangdong, distrito de Tianhe, China

** Nota: Quando você transferir dinheiro para nossa conta bancária, NÃO escreva nada na área de comentários, caso contrário, não poderemos receber o pagamento devido à política governamental sobre negócios de comércio internacional.

|

|

|

|

* Será enviada em 1 2-dia de trabalho quando o pagamento clara.

* Nós vamos enviá-lo para seu endereço de paypal. Se você quiser mudar de endereço, por favor, envie seu endereço correto e número de telefone para o meu e-mail [email protegido]

* Se os pacotes está abaixo 2kg, que serão enviados via correio aéreo, vai demorar cerca de 15-25days para sua mão.

Se o pacote é mais do que 2kg, nós enviamos via EMS, DHL, UPS, Fedex entrega rápida expressa, vai demorar cerca de 7 ~ 15days para sua mão.

Se o pacote de mais de 100kg, iremos enviar via DHL ou frete aéreo. Isso levará cerca de 3 ~ 7days para sua mão.

Todos os pacotes são a forma China Guangzhou.

* O pacote será enviado como um "presente" e descontar o menos possível, o comprador não precisa pagar por "TAX".

* Depois de navio, nós lhe enviaremos um e-mail e dar-lhe o número de rastreamento.

|

|

|

Para garantia.

Entre em contato conosco --- >> Devolva o item para nós --- >> Receba e envie outra substituição.

Nome: Liu Xiaoxia

Endereço: 305Fang HuiLanGe HuangPuDaDaoXi 273Hao TianHeQu Guangzhou China.

CEP: 510620

Telefone: + 8618078869184

Por favor, retorne a este endereço e escrever seu paypal endereço, nome, problema na nota: |

|